प्रमुख कंप्यूटर वैज्ञानिकों और अन्य तकनीकी उद्योग के प्रतिष्ठित लोगों का एक समूह कृत्रिम बुद्धिमत्ता तकनीक पर छह महीने के विराम की मांग कर रहा है। (Shutterstock)

कंप्यूटर वैज्ञानिकों और तकनीकी उद्योग के नेताओं द्वारा हाल ही में एक खुला पत्र आर्टिफिशियल इंटेलिजेंस डेवलपमेंट पर छह महीने की रोक लगाने की मांग की है ऑनलाइन व्यापक ध्यान प्राप्त किया. यहां तक कि कनाडा के इनोवेशन मिनिस्टर फ्रांकोइस-फिलिप शैंपेन भी ट्विटर पर पत्र का जवाब दिया है।

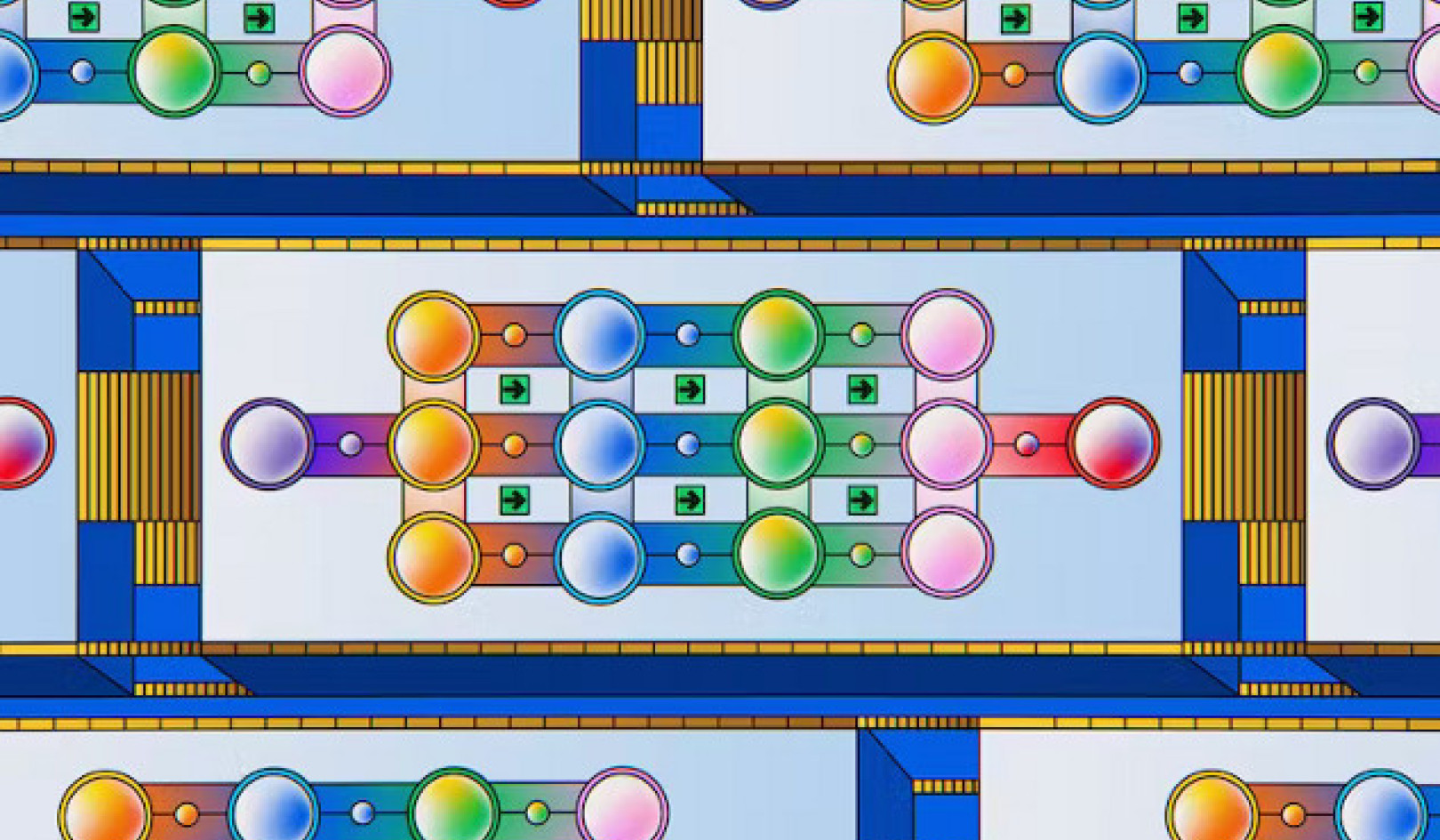

नॉन-प्रॉफिट फ्यूचर ऑफ लाइफ इंस्टीट्यूट द्वारा प्रकाशित पत्र में सभी एआई प्रयोगशालाओं से चैटजीपीटी के पीछे के मॉडल जीपीटी-4 की तुलना में अधिक शक्तिशाली एआई सिस्टम का प्रशिक्षण बंद करने के लिए कहा गया है। पत्र का तर्क है कि एआई को "अधिक शक्तिशाली डिजिटल दिमाग विकसित करने और तैनात करने के लिए एक नियंत्रण से बाहर की दौड़ में बंद कर दिया गया है, जिसे कोई भी - उनके निर्माता भी नहीं - समझ सकते हैं, भविष्यवाणी कर सकते हैं या मज़बूती से नियंत्रित कर सकते हैं।"

पत्र मानता है कि एआई बन रहा है, या "शक्तिशाली डिजिटल दिमाग" बन सकता है - ए एआई के विकास की दीर्घकालिक व्याख्या कि भविष्य की चिंताओं के एवज में आज एआई के बारे में महत्वपूर्ण बहसों को अनदेखा करता है.

दीर्घकालिकवाद और ए.आई

दीर्घायुवाद है विश्वास है कि कृत्रिम बुद्धि नियंत्रण से बाहर अधीक्षण बनकर मानवता के भविष्य के लिए दीर्घकालिक या अस्तित्वगत जोखिम पैदा करती है.

अधीक्षण एआई के बारे में चिंताएं आमतौर पर विज्ञान कथाओं का सामान होती हैं। एआई कल्पनाएँ सिलिकॉन वैली में कई आशंकाओं में से एक हैं वह नेतृत्व कर सकता है अंधेरे भविष्यवाणियां. लेकिन जैसे पीड़ा नेक्सस मेमे, ये चिंताएँ बड़े निवेश में तब्दील होती हैं, सावधानी नहीं। अधिकांश प्रमुख प्रौद्योगिकी फर्मों के पास है उनकी जिम्मेदार एआई टीमों को काटें.

ChatGPT स्पष्ट रूप से अधीक्षण का मार्ग नहीं है। खुला पत्र एआई भाषा प्रौद्योगिकी जैसे चैटजीपीटी को एक संज्ञानात्मक सफलता के रूप में देखता है - ऐसा कुछ जो एआई को सामान्य कार्यों में मनुष्यों के साथ प्रतिस्पर्धा करने की अनुमति देता है। लेकिन यह सिर्फ एक राय है।

ऐसे कई अन्य लोग हैं जो चैटजीपीटी, इसके जीपीटी-4 मॉडल और अन्य भाषा सीखने के मॉडल को इस रूप में देखते हैं "स्टोकेस्टिक तोते" जो वे ऑनलाइन सीखते हैं उसे केवल दोहराते हैं ताकि वे दिखाई देते हैं मनुष्यों के लिए बुद्धिमान।

अधीक्षण के अंधे धब्बे

दीर्घावधिवाद के प्रत्यक्ष नीतिगत निहितार्थ हैं जो अधिक दबाव वाले मामले जैसे अधीक्षण को प्राथमिकता देते हैं एआई की शक्ति असंतुलन. दीर्घकालिकवाद के कुछ समर्थक यहां तक कि जलवायु आपातकाल को संबोधित करने की तुलना में अधीक्षण को रोकने के लिए विनियमन पर विचार करना अधिक आवश्यक है।

एआई नीति के निहितार्थ तत्काल हैं, दूर के मामले नहीं। क्योंकि GPT-4 को संपूर्ण इंटरनेट पर प्रशिक्षित किया गया है और इसके स्पष्ट रूप से व्यावसायिक लक्ष्य हैं, यह फेयर डीलिंग और फेयर यूज पर सवाल उठाता है.

हम अभी भी नहीं जानते हैं कि एआई-जेनरेट किए गए टेक्स्ट और छवियां पहले स्थान पर कॉपीराइट योग्य हैं या नहीं, मशीनों के बाद से और जानवरों कॉपीराइट नहीं रख सकता।

और जब गोपनीयता के मामलों की बात आती है, तो चैटजीपीटी के दृष्टिकोण को अन्य एआई एप्लिकेशन से अलग करना कठिन है, क्लीयर AI. दोनों एआई मॉडल को खुले इंटरनेट पर एकत्रित बड़ी मात्रा में व्यक्तिगत जानकारी का उपयोग करके प्रशिक्षित किया गया था। इटली के डेटा-संरक्षण प्राधिकरण ने गोपनीयता संबंधी चिंताओं को लेकर चैटजीपीटी पर प्रतिबंध लगा दिया है.

खुले पत्र में इन तात्कालिक जोखिमों का उल्लेख नहीं किया गया है, जो जंगली दर्शन और तकनीकी समाधानों के बीच झूलते हैं, उन मुद्दों की अनदेखी करते हैं जो हमारे सामने हैं।

व्यावहारिकता डूब रही है

पत्र एक पुराने गतिशील का अनुसरण करता है जिसे मेरे सह-लेखक और मैं एक में पहचानता हूं एआई गवर्नेंस के बारे में आगामी सहकर्मी-समीक्षित अध्याय. एआई को एक अस्तित्वगत जोखिम या कुछ सांसारिक और तकनीकी के रूप में देखने की प्रवृत्ति है।

इन दो चरम सीमाओं के बीच का तनाव खुले पत्र में प्रदर्शित होता है। "तकनीकी एआई सुरक्षा अनुसंधान के लिए मजबूत सार्वजनिक धन" का आह्वान करने से पहले "उन्नत एआई पृथ्वी पर जीवन के इतिहास में गहरा बदलाव का प्रतिनिधित्व कर सकता है" का दावा करते हुए पत्र शुरू होता है। उत्तरार्द्ध का सुझाव है कि एआई के सामाजिक नुकसान को हल करने के लिए केवल तकनीकी परियोजनाएं हैं।

इन दो चरम सीमाओं पर ध्यान ऊपर उल्लिखित एआई के तत्काल जोखिमों के साथ-साथ व्यावहारिक रूप से चर्चा करने की कोशिश कर रहे महत्वपूर्ण आवाजों को भीड़ देता है श्रम मुद्दे और बहुत कुछ.

खुले पत्र पर दिया जा रहा ध्यान कनाडा में विशेष रूप से समस्याग्रस्त है क्योंकि दो अन्य पत्र, द्वारा लिखे गए हैं कलाकारों और नागरिक स्वतंत्रता संगठनों, उतना ध्यान नहीं मिला है। ये पत्र सुधारों और इससे प्रभावित होने वालों की रक्षा के लिए एआई शासन के लिए एक अधिक मजबूत दृष्टिकोण का आह्वान करते हैं।

एआई कानून की ओर एक अनावश्यक व्याकुलता

खुले पत्र पर सरकार की प्रतिक्रियाओं ने जोर दिया है कि कनाडा के पास कानून है - आर्टिफिशियल इंटेलिजेंस एंड डेटा एक्ट (AIDA). AI के दीर्घकालिक जोखिमों का उपयोग अब AIDA की तरह कानून बनाने के लिए किया जा रहा है।

AIDA उचित AI शासन व्यवस्था की दिशा में एक महत्वपूर्ण कदम है, लेकिन इसकी आवश्यकता है एआई से प्रभावित लोगों से बेहतर सलाह लें लागू होने से पहले। कथित दीर्घकालिक आशंकाओं का जवाब देने के लिए इसे जल्दी नहीं किया जा सकता है।

एआई कानून में तेजी लाने के लिए पत्र की कॉल आज एआई अनुसंधान को चलाने वाली कुछ ही फर्मों को लाभ पहुंचा सकती है। परामर्श के लिए समय के बिना, सार्वजनिक साक्षरता को बढ़ाएं और एआई से प्रभावित होने वालों को सुनें, एआईडीए की जवाबदेही से गुजरने का जोखिम और प्रौद्योगिकी से लाभान्वित होने के लिए पहले से ही अच्छी तरह से तैनात संस्थानों को ऑडिट करना, एक नए एआई ऑडिटिंग उद्योग के लिए एक बाजार बनाना।

मानवता का भाग्य लाइन पर नहीं हो सकता है, लेकिन एआई का सुशासन निश्चित रूप से है।![]()

के बारे में लेखक

फेनविक मैककेल्वे, सूचना और संचार प्रौद्योगिकी नीति में एसोसिएट प्रोफेसर, Concordia विश्वविद्यालय

इस लेख से पुन: प्रकाशित किया गया है वार्तालाप क्रिएटिव कॉमन्स लाइसेंस के तहत। को पढ़िए मूल लेख.